「AUTOMATIC1111版web UIでSDXLを動かしたい」

「AUTOMATIC1111版web UIにおけるRefinerのサポート状況は?」

このような場合には、この記事の内容が参考になります。

本記事の内容

- 最新版AUTOMATIC1111版web UIのインストール

- AUTOMATIC1111版web UIでSDXLの動作確認

- AUTOMATIC1111版web UIにおけるRefinerのサポート状況

それでは、上記に沿って解説していきます。

最新版AUTOMATIC1111版web UIのインストール

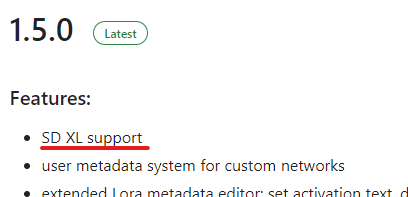

2023年7月25日、ついにAUTOMATIC1111版web UIで正式にSDXLがサポートされました。

SDL 1.0のリリースになんとか間に合った感じです。

まあ、すでにSDXL 1.0は延期されていますけどね。

追記 2023年7月27日

SDXL 1.0が正式にリリースされました。

次の記事では、LoRAの適用方法などを説明しています。

SDXLを試すには、最新版AUTOMATIC1111版web UIが必要となります。

基本的には、次の記事に従えば最新版をインストールできます。

web UIをインストールできたら、モデルをダウンロードしましょう。

https://huggingface.co/stabilityai/stable-diffusion-xl-base-0.9/tree/main

上記をダウンロードするには、規約への同意などが必要となります。

詳細は、次の記事の「SDXLのダウンロード」をご覧ください。

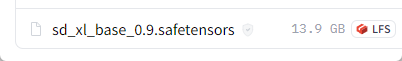

「sd_xl_base_0.9.safetensors」をダウンロードできたら、あとはいつもと同じです。

ダウンロードしたファイルを指定のディレクトリ(models/Stable-diffusion)に設置します。

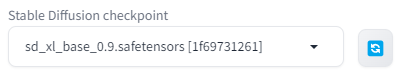

web UIの起動後、以下のようにcheckpointを選択できるようになっています。

とりあえず、これでSDXLを利用できるようになりました。

以上、最新版AUTOMATIC1111版web UIのインストールを説明しました。

次は、AUTOMATIC1111版web UIでSDXLの動作確認を説明します。

AUTOMATIC1111版web UIでSDXLの動作確認

SDXLは、約14GBもある大きいモデルです。

そのため、web UIの処理も遅くなります。

それを少しでも改善するために、web UIの高速化を行いましょう。

詳細は、上記の記事で説明しています。

次のコマンドでweb UIを起動すれば、画像生成の処理が速くなります。

python launch.py --no-half-vae --opt-sdp-attention --opt-sdp-no-mem-attention

ただし、PyTorch 2系の利用が前提です。

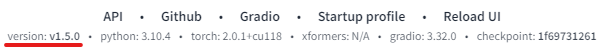

web UIが起動できたら、画面最下部を確認しましょう。

SDXLを動かすには、v1.5.0以降である必要があります。

web UIのバージョンを確認できれば、画像を生成してみましょう。

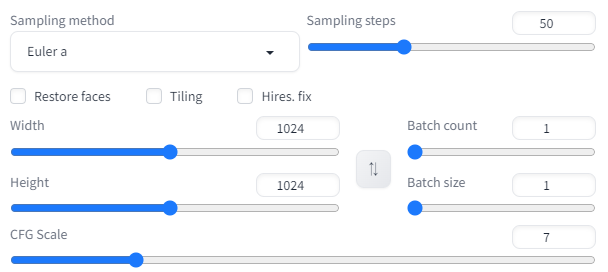

設定は、次のようにします。

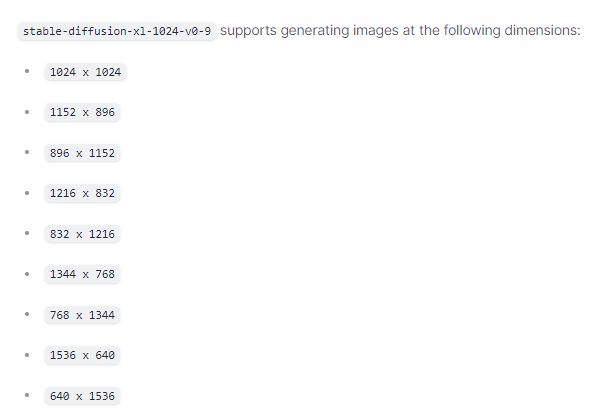

なお、SDXL 0.9でサポートしている解像度は以下となっています。

プロンプトは、以下を用います。

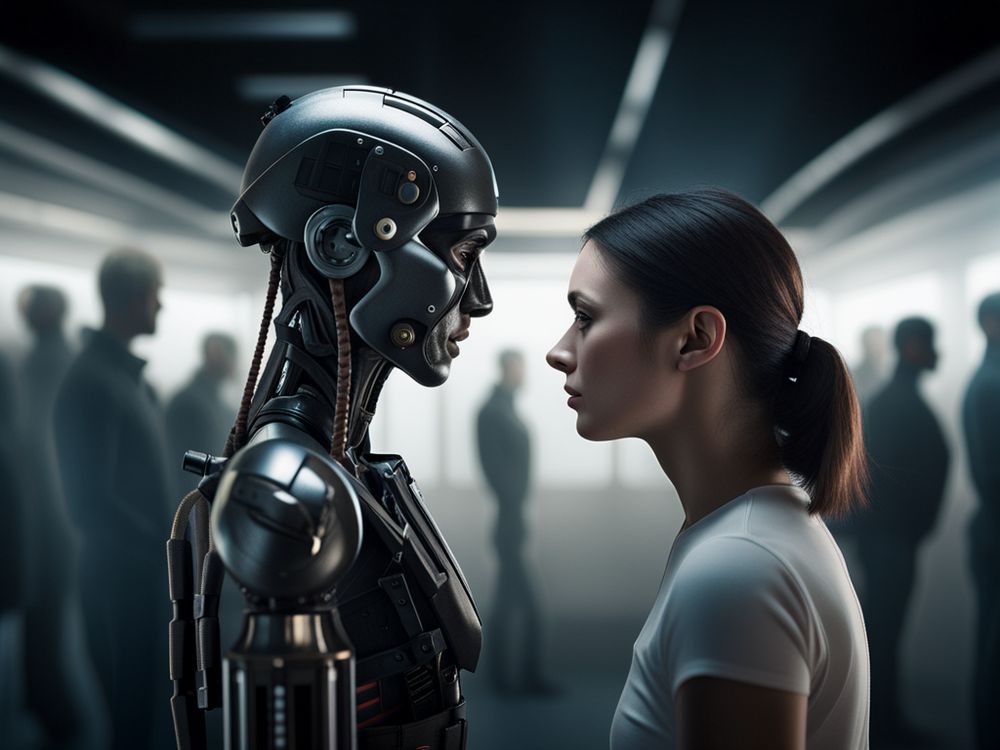

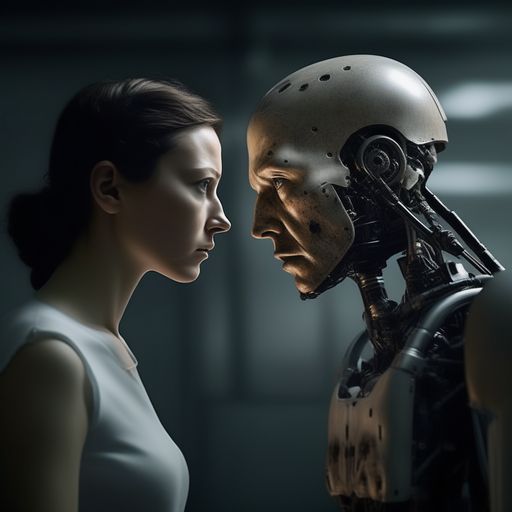

Imagine a scene of a human and an AI in conflict, their struggle symbolizing the broader tension between technology and humanity. The medium is a hyper-realistic photograph, with a style that captures the stark reality of this conflict. The lighting is harsh and unforgiving, illuminating the determined expression of the human and the unfeeling gaze of the AI. The composition is a close-up shot, taken with a Nikon D850 DSLR, using a Nikkor 85mm f/1.4G lens. The resolution is 45.7 megapixels, ISO sensitivity: 25,600, Shutter speed 1/8000 second.

「AIと人の争い」をお題にChatGPTに作成させています。

詳細は、次の記事で説明しています。

この条件で生成した画像は、以下。

1024 x 1024を512 x 512に縮小しています。

この際にかかった時間やGPU使用率は、以下。

(※RTX 3090を利用)

Time taken: 17.5 sec. A: 10.24 GB, R: 11.98 GB, Sys: 14.3/24 GB (59.6%)

以上、AUTOMATIC1111版web UIでSDXLの動作確認を説明しました。

次は、AUTOMATIC1111版web UIにおけるRefinerのサポート状況を説明します。

AUTOMATIC1111版web UIにおけるRefinerのサポート状況

Refinerのサポート状況については、情報が錯綜しています。

追記 2023年8月27日

1.6.0から正式にサポートされることになりました。

1.5.0のリリースノートを見る限りでは、明記はされていません。

https://github.com/AUTOMATIC1111/stable-diffusion-webui/releases

そのため、web UIの開発者に対してRefinerのサポート依頼(リクエスト)が行われています。

https://github.com/AUTOMATIC1111/stable-diffusion-webui/issues/11919

ただし、現状でもRefinerを適用させることが可能です。

手間はかかりますけどね。

その方法を以下に載せておきます。

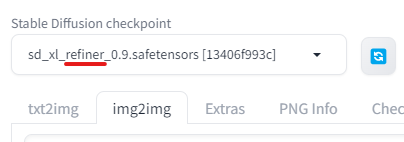

まず、「txt2img」で画像を生成します。

その前にRefiner用のモデル「sd_xl_refiner_0.9.safetensors」を設置しておいてください。

https://huggingface.co/stabilityai/stable-diffusion-xl-refiner-0.9/tree/main

気に入った画像ができたら、その画像を「img2img」に送ります。

「img2img」に画面が切り替わったら、Refinerのモデルを選択します。

この状態で「Denoising strength」の値を「0.2~0.3」ほどに設定します。

サイズは、「txt2img」で画像を生成した際のサイズに合わせます。

設定できたら、「Generate」ボタンをクリック。

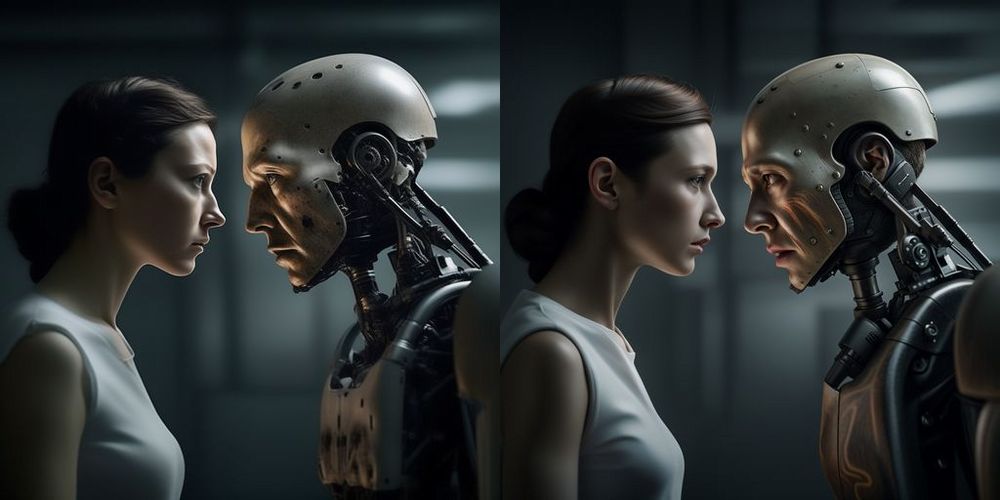

そうすると、次のような画像を生成できます。

この際にかかった時間やGPU使用率は、以下。

Time taken: 6.3 sec. A: 10.62 GB, R: 11.08 GB, Sys: 13.4/24 GB (55.8%)

画像が綺麗になったのが、わかりますか?

わかりやすいように、比較画像を載せておきます。

(左がtxt2imgで生成した画像、右がimg2imgでRefinerを適用させた画像)

一応、Refinerが有効になったことを確認できます。

でも、Refinerのサポートをリクエストしている人はこの方法が不満のようです。

他には、拡張機能を用いる方法などが存在しています。

とりあえず、SDXL 1.0が公開されたら、この辺の状況は改善されるとは思います。

それが待てない人は、SD.Nextの利用をオススメします。

SD.Nextであれば、Refinerが容易に利用できるようになっています。

以上、AUTOMATIC1111版web UIにおけるRefinerのサポート状況を説明しました。