「画像生成AIのように文字を入力するだけで動画も生成したい」

「動画をベースに新たな動画を生み出したい」

このような場合には、TokenFlowがオススメです。

この記事では、TokenFlowについて解説しています。

本記事の内容

- TokenFlowとは?

- TokenFlowのインストール

- TokenFlowの動作確認

それでは、上記に沿って解説していきます。

TokenFlowとは?

TokenFlowとは、AIを用いた動画編集技術のことです。

編集というところが、ポイントになります。

あくまで、元となる動画は存在している必要があります。

その元動画を入力にして、AIを用いて新たに動画を生成するのです。

その際、AIに指示するのはテキストを用います。

つまり、動画をテキストで編集できるということです。

例えば、以下は「a raw meat」と入力して生成した動画になります。

入力にはパンを切る動画を用いています。

公式によるデモは、次のページで確認できます。

https://diffusion-tokenflow.github.io/sm/supp.html

動画を生成する際には、Stable Diffusionを利用しています。

Stable Diffusionで動画の画像を生成しているのです。

ある意味、TokenFlowは画像生成AIの進化形と言えます。

2022年の夏頃にStable Diffusionがリリースされて、1年でここまで来ましたか。。。

新規で動画自体を生成する技術としては、AnimateDiffがあります。

TokenFlowと異なり、AnimateDiffは元動画を必要としません。

AnimateDiffも現在進行形で進化しているようです。

画像生成AIに加えて、動画生成AIも今後注目を浴びていくことでしょう。

以上、TokenFlowについて説明しました。

次は、TokenFlowのインストールを説明します。

TokenFlowのインストール

上記でTokenFlowのソースが公開されています。

また、Hugging Face上でデモが利用できます。

どうせなら、GUIで操作できるモノをインストールしたいですよね。

ということで、今回はHugging Face上のデモをインストールしましょう。

TokenFlowのインストールは、Python仮想環境の利用をオススメします。

Python仮想環境は、次の記事で解説しています。

検証は、次のバージョンのPythonで行います。

> python -V Python 3.10.4

では、TokenFlowのインストールを進めていきましょう。

ただし、事前にGPU版PyTorchはインストール済みとします。

動画編集の処理には、かなり時間がかかります。

ちょっとでも高速に処理できるPyTorch 2系を利用することをオススメしておきます。

PyTorchがインストール済みなら、次のコマンドを実行します。

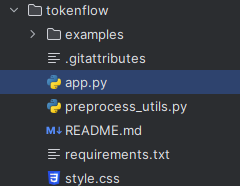

git clone https://huggingface.co/spaces/weizmannscience/tokenflow cd tokenflow

これでデモ一式をダウンロードできます。

そして、リポジトリルートに移動します。

移動できたら、次のコマンドを実行しましょう。

pip install -r requirements.txt pip install gradio

これだけで必要なモノが、すべてインストールされます。

以上、TokenFlowのインストールを説明しました。

次は、TokenFlowの動作確認を説明します。

TokenFlowの動作確認

TokenFlowの動作確認を行います。

ダウンロードしたソース内のapp.pyを起動します。

次のコマンドでデモプログラムを起動できます。

python app.py

コンソールに次のように表示されたら、起動はOKです。

Running on local URL: http://127.0.0.1:7860 To create a public link, set `share=True` in `launch()`.

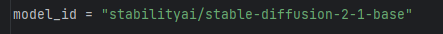

初回起動時には、必要なモデルをダウンロードする処理が実行されます。

app.pyを見ると、次のモデルが用いられていることを確認できます。

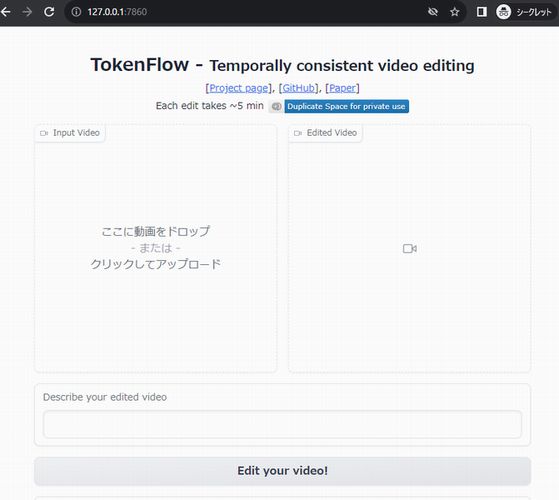

起動を確認できたら、ブラウザで「http://127.0.0.1:7860」にアクセス。

Hugging Face上のデモ画面を同じモノを確認できますね。

あとは、動画をアップロードしてプロンプトを入力するのみです。

今回は、用意されている動画を利用しましょう。

次の4つから選択できます。

ここでは、パンを切っている動画を選択。

そして、「Describe your edited video」にはテキストを入力します。

a raw meat

準備ができたら、「Edit your video!」ボタンをクリック。

処理は、そこそこ待たされます。

5分~10分ぐらいの間では、完了しているはずです。

と言っても、各自の利用環境でこの数字は異なります。

ちなみに、検証マシンはRTX 3090を利用しています。

あと、GPUメモリ不足でエラーになる可能性もありますね。

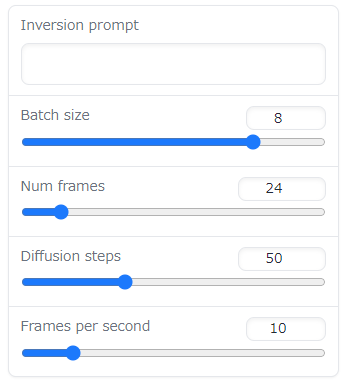

それは、その場合は「Advanced Options」で数字の調整をしてみましょう。

結果として、生成された動画はすでに紹介済みです。

肉を切る動画ですね。

以上、TokenFlowの動作確認を説明しました。