「Anything V5は、Anything v3.0やv4.0とどういう関係なの?」

「短いプロンプトで高品質・高精細なアニメ風画像を生成したい」

このような場合には、この記事の内容がオススメです。

この記事では、 Anything V5について解説しています。

本記事の内容

- Anything V5とは?

- Anything V5の利用方法

- 各Anythingモデルの比較

それでは、上記に沿って解説していきます。

Anything V5とは?

Anything V5 | Anything diffusion Original

https://civitai.com/models/9409

ついにAnything v3.0をアップロードした人物が、公の場に出てきました。

その証拠画像が、Civitai上の公式ページに掲載されています。

そして、Anything v4.0・v4.5とは無関係であることにも言及しています。

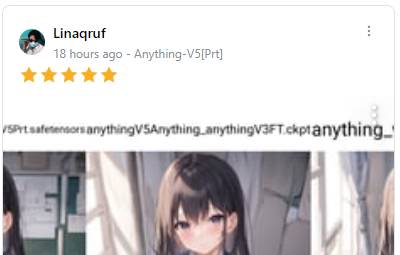

また、Anything v3.0をHugging Faceにアップロードした人物がレビューに登場しています。

Anything v3.0の開発者として、出てきてくれたことに感謝しているようです。

そして、Hugging Face上のリポジトリを譲ることを提案しています。

その提案に対して、本当の開発者である99999779氏は断っています。

英語ができず、Hugging Face上のアカウント自体もないという理由で。

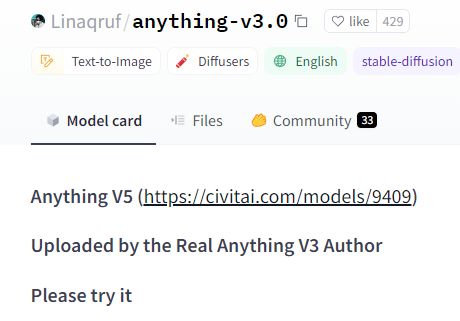

その結果、Hugging Face上のAnything v3.0ページは次のように変更されています。

これで、Anythingモデルの謎はかなり解明されました。

ただ、肝心のAnything V5の品質についてはイマイチわかりません。

Civitai上のユーザー投稿を見ると、すでに検証しているユーザーがいます。

Anything v3.0よりも良いことは確実です。

しかし、Anything v4.0やv4.5相手だと、一概にそうとは言えません。

そもそも開発者が異なるので、比較する自体がナンセンスかもしれませんけどね。

でも、一応「各Anythingモデルの比較」を実施しています。

「なるほどなー」と感じる結果にはなっています。

以上、Anything V5について説明しました。

次は、Anything V5の利用方法を説明します。

Anything V5の利用方法

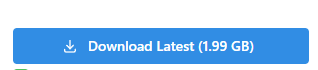

まずは、公式ページからモデルをダウンロードします。

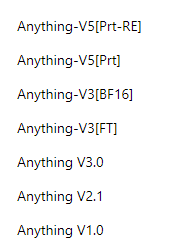

複数バージョンが用意されています。

通常は、「Anything-V5[Prt-RE]」で問題ありません。

次のボタンをクリックすれば、「Anything-V5[Prt-RE]」をダウンロードできます。

今回ダウンロードできたファイルは、「anythingV5Anything_anythingV5PrtRE.safetensors」です。

利用方法については、それぞれの環境で異なります。

- Stable Diffusion web UI(AUTOMATIC1111版)

- Diffusers

それぞれの場合を以下で説明します。

Stable Diffusion web UI(AUTOMATIC1111版)

web UIのインストールは、次の記事で説明しています。

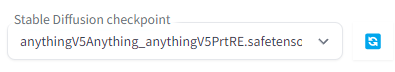

web UIの場合は、特に難しいことは何もありません。

ダウンロードしたファイルを指定のディレクトリ(models/Stable-diffusion)に設置するだけです。

web UIの起動後、以下のようにcheckpointを選択できるようになっています。

Diffusers

Diffusersの場合は、少し工夫が必要となります。

Anything V5の開発者が、Hugging Faceにアカウントすら持っていませんからね。

まずは、Stable Diffusionを動かす環境を用意します。

上記記事に従えば、自ずとDiffusersをインストールすることになります。

Diffusersの場合、そのままではダウンロードしたモデルを読み込めません。

そのため、Diffusersで利用できるように変換処理を行う必要があります。

Safetensors形式ファイルの変換処理は、次の記事で解説しています。

今回変換に用いたのは、以下のコマンドになります。

python convert_diffusers20_original_sd.py ..\..\ckpt\anythingV5Anything_anythingV5PrtRE.safetensors ..\..\model\anythingV5Anything_anythingV5PrtRE --v1 --reference_model runwayml/stable-diffusion-v1-5

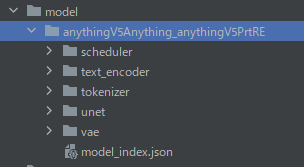

変換に成功すると、次のようなディレクトリ・ファイルが作成されます。

ここまで準備できたら、あとは次のコードで画像生成が可能です。

from diffusers import StableDiffusionPipeline, EulerAncestralDiscreteScheduler

model_id = "./model/anythingV5Anything_anythingV5PrtRE"

pipe = StableDiffusionPipeline.from_pretrained(model_id)

pipe.scheduler = EulerAncestralDiscreteScheduler.from_config(pipe.scheduler.config)

pipe = pipe.to("cuda")

# pipe.enable_attention_slicing()

prompt = "masterpiece, best quality, 1girl, white hair, medium hair, cat ears, closed eyes, looking at viewer, :3, cute, scarf, jacket, outdoors, streets"

negative_prompt = " (deformed iris, deformed pupils, semi-realistic, cgi, 3d, render, sketch, cartoon, drawing, anime:1.4), text, close up, cropped, out of frame, worst quality, low quality, jpeg artifacts, ugly, duplicate, morbid, mutilated, extra fingers, mutated hands, poorly drawn hands, poorly drawn face, mutation, deformed, blurry, dehydrated, bad anatomy, bad proportions, extra limbs, cloned face, disfigured, gross proportions, malformed limbs, missing arms, missing legs, extra arms, extra legs, fused fingers, too many fingers, long neck"

image = pipe(

prompt,

num_inference_steps=25,

guidance_scale=7,

width=512,

height=512,

negative_prompt=negative_prompt

).images[0]

image.save("test.png")

このコードを実行すると、次のような画像が生成されます。

以上、Anything V5の利用方法を説明しました。

次は、各Anythingモデルの比較を説明します。

各Anythingモデルの比較

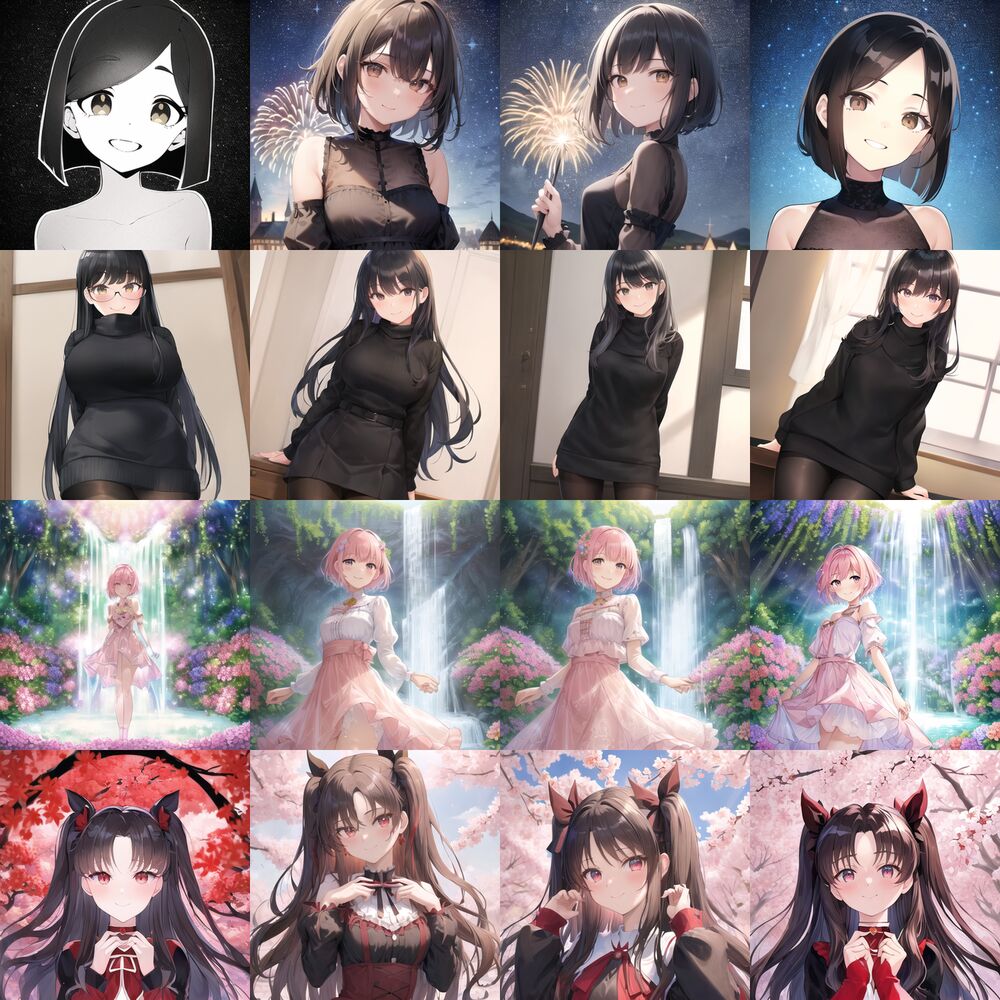

歴代のAnythingシリーズの出力結果を比較します。

| Anything v3.0 | Anything v4.0 | Anything v4.5 | Anything V5 |

結果を見て、どうでしょうか?

明らかに、Anything v3.0が格下であることはわかります。

ただ、4系と5系では品質的には変わらないように感じます。

でも、コントラストは5系の方が良いのかもしれませんね。

あと、5系は3系を正当に継いでいることが確認できます。

構図的には、ほぼ同じです。

以上、各Anythingモデルの比較を説明しました。