「高品質のヤバいNSFWのイラストを生成したい!」

「モデルが多すぎて、どれを選んでよいのかわからない・・・」

このような場合には、Grapefruitがオススメです。

この記事では、Grapefruitについて解説しています。

本記事の内容

- Grapefruitとは?

- Grapefruitの利用方法

それでは、上記に沿って解説していきます。

Grapefruitとは?

Grapefruitは、明るく柔軟なhentai modelを目指しているということです。

Civitai上で、アニメ生成モデルとしては最も人気のあるモデルと言えます。

生成できる画像は、hentai modelの名にふさわしいモノとなっています。

とにかく、ヤバいアニメ画像を生成したいなら、Grapefruitがオススメと言えます。

そんなヤバい画像は、次の公式ページから確認することが可能です。

Grapefruit (hentai model) | Stable Diffusion Checkpoint | Civitai

https://civitai.com/models/2583/grapefruit-hentai-model

現状、Grapefruitの最新版はV 3.1となります。

この最新バージョンは、次のモデルを結合して作成されています。

- AnythingV3

- ElysiumV2

- AbyssOrangeMix

- AbyssOrangeMix2

- basilMix

また、Samplerは以下が推奨されています。

- DDIM

- DPM++ SDE Karras

モデル製作者は、DDIMが好みだそうです。

以上、Grapefruitについて説明しました。

次は、Grapefruitの利用方法を説明します。

Grapefruitの利用方法

利用方法については、それぞれの環境で異なります。

- Stable Diffusion web UI(AUTOMATIC1111版)

- Diffusers

それぞれの場合について、以下で説明します。

Stable Diffusion web UI(AUTOMATIC1111版)

お試し感覚でweb UIのインストールができる方法を次の記事で説明しています。

LinuxでもWindowsでも、macOSでも何でもOKです。

まずは、Civitai上の公式ページからceckpointをダウンロードします。

https://civitai.com/models/2583/grapefruit-hentai-model

ただし、ログインが必須となります。

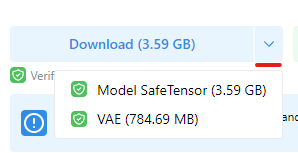

ログインした状態でアクセスすると、「Download」ボタンからダウンロードが可能です。

ModelとVAEの両方ともをダウンロードしましょう。

ダウンロードしたファイルは、以下となります。

- grapefruitHentaiModel_grapefruitv31.safetensors

- grapefruitV3_1.vae.pt

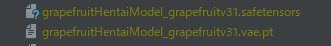

VAEに関しては、次のようにファイル名を変更します。

「grapefruitHentaiModel_grapefruitv31.vae.pt」

そして、これらのファイルを指定のディレクトリ(stable-diffusion-webui/models/Stable-diffusion)に設置します。

この状態で、web UIを起動するとコンソールには次のように表示されます。

Loading weights [4fc8d3739f] from ~\stable-diffusion-webui\models\Stable-diffusion\grapefruitHentaiModel_grapefruitv31.safetensors Loading VAE weights found near the checkpoint: ~\stable-diffusion-webui\models\Stable-diffusion\grapefruitHentaiModel_grapefruitv31.vae.pt

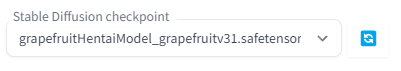

web UIの起動後、以下のようにcheckpointを選択します。

この状態で画像を生成すると、VAEの効果ありとなります。

では、実際に画像を生成してみましょう。

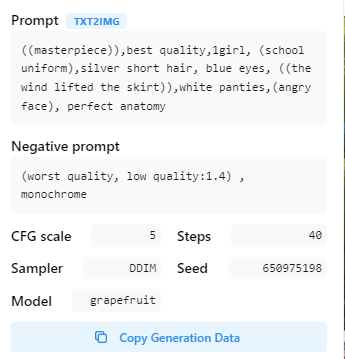

プロンプトは、ユーザー投稿などを参考にできます。

「i」アイコンをクリックすると、次のような情報が表示されます。

このプロンプトを参考にして、生成したのが次の画像です。

確かに、かなり質は高いですね。

Diffusers

Diffusersの場合は、若干面倒です。

まずは、Stable Diffusionを動かせることが前提になります。

上記記事に従えば、自ずとDiffusersをインストールすることになります。

では、面倒な処理を進めていきましょう。

まず、モデルとVAEをCivitai上の公式ページからダウンロードします。

ダウンロード方法は、上記「Stable Diffusion web UI(AUTOMATIC1111版)」に記載しています。

以下のファイルダウンロードまでは、全く同じです。

- grapefruitHentaiModel_grapefruitv31.safetensors

- grapefruitV3_1.vae.pt

これらのファイルは、そのままではDiffusersからは読み込めません。

そのため、Diffusersで利用できるように変換処理を行います。

モデルの変換

Safetensors形式の変換処理は、次の記事で解説しています。

今回は、次のコマンドで変換を行いました。

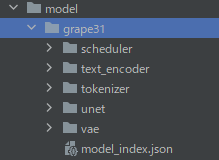

python convert_diffusers20_original_sd.py ..\..\ckpt\grapefruitHentaiModel_grapefruitv31.safetensors ..\..\model\grape31 --v1 --reference_model runwayml/stable-diffusion-v1-5

変換に成功すると、次のようなディレクトリ・ファイルが作成されます。

VAEの変換

ptファイルのままだと、DiffusersではVAEとして利用できません。

そのため、DiffusersでVAEとして利用できるようにptファイルを変換します。

その方法は、次の記事で解説しています。

記事通りにやれば、問題なく変換できます。

上記記事を参考にして、次のコマンドで変換しています。

パスについては、各自の環境に合わせてください。

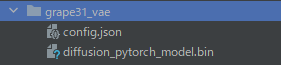

python convert_pt_to_bin.py --checkpoint_path ..\..\ckpt\grapefruitV3_1.vae.pt --dump_path ..\..\model\grape31_vae

上記コマンドを実行すると、次のような形に変換できます。

ここまで準備できたら、あとは次のコードを実行するだけです。

from diffusers import StableDiffusionPipeline, EulerAncestralDiscreteScheduler

from diffusers.models import AutoencoderKL

model_id = "./model/grape31"

vae = AutoencoderKL.from_pretrained("./model/grape31_vae")

pipe = StableDiffusionPipeline.from_pretrained(model_id, vae=vae)

pipe.scheduler = EulerAncestralDiscreteScheduler.from_config(pipe.scheduler.config)

pipe = pipe.to("cuda")

prompt = "((masterpiece)),best quality,1girl, (school uniform),silver short hair, blue eyes, (angry face), perfect anatomy"

negative_prompt = "(worst quality, low quality:1.4), monochrome, text, logo, signature, bad hands"

image = pipe(

prompt,

num_inference_steps=40,

guidance_scale=5,

width=512,

height=704,

negative_prompt=negative_prompt

).images[0]

image.save("test.png")

上記を実行すると、次のような画像が生成されます。

表情を上手く表現していますね。

そして、手が綺麗に出ることが多いです。

ただ、基本的にはNSFW的な画像が生成されます。

その中から、ここでお見せできる画像を選ぶのは大変です・・・

Grapefruitの利用方法を説明しました。